El gobierno del Reino Unido define el Aseguramiento de IA (AI Assurance) como «el proceso de medir, evaluar y comunicar la fiabilidad de los sistemas de IA». El mercado supera los mil millones de libras. PwC, EY, KPMG y Deloitte tienen sus propias ofertas. Más de 524 empresas solo en el Reino Unido trabajan en alguna forma de Aseguramiento de IA.

Y sin embargo, si le preguntas a un desarrollador qué significa el Aseguramiento de IA para su flujo de trabajo, obtendrás una mirada en blanco. Si le preguntas a un responsable de cumplimiento cómo implementarlo sin contratar a una Big 4, obtendrás una mirada en blanco más larga.

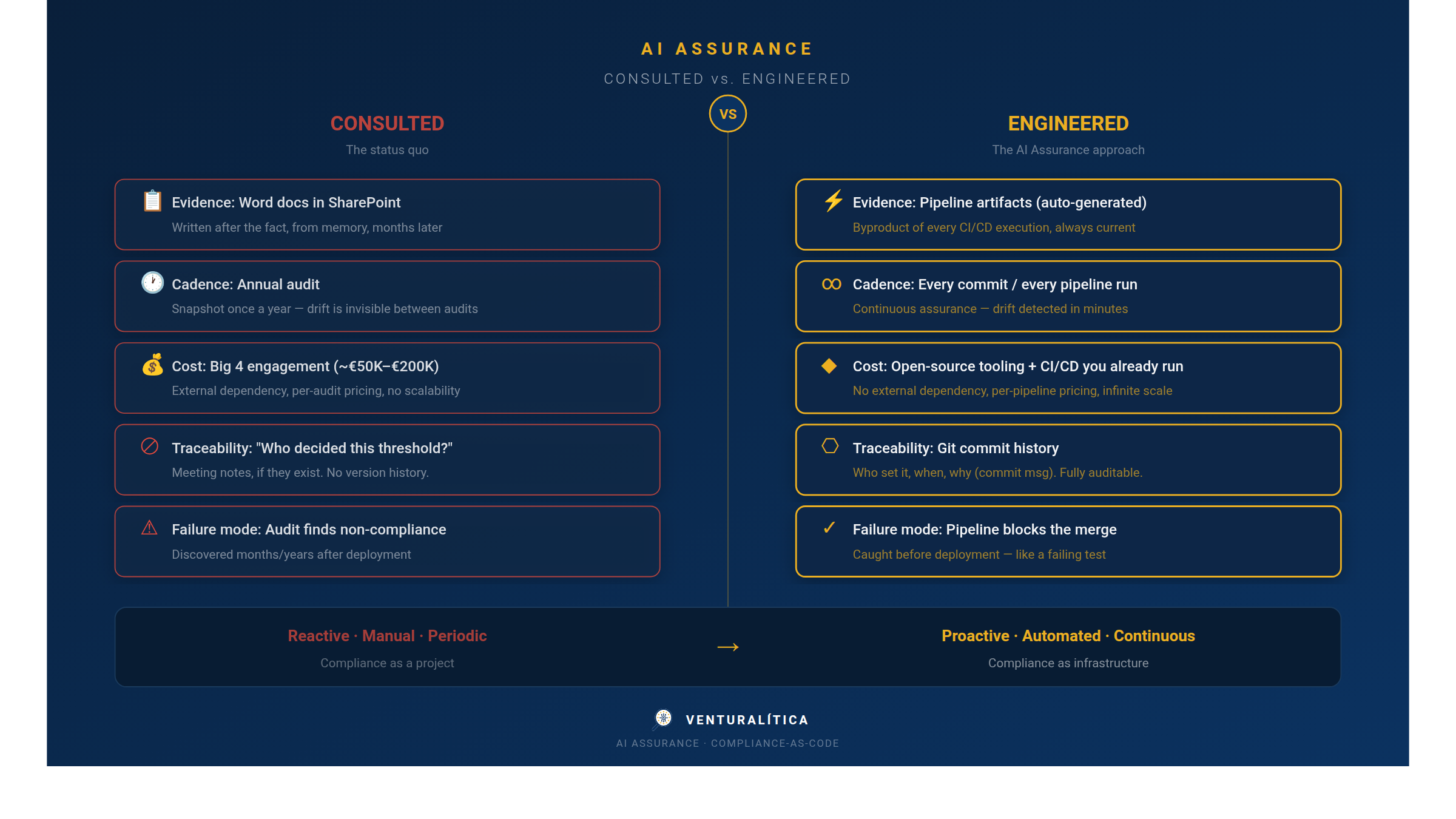

El problema no es que el Aseguramiento de IA sea un concepto vago. Es que la mayoría de definiciones describen un resultado — IA confiable — sin describir el mecanismo. Es como definir DevOps como «entregar software de forma fiable» sin mencionar CI/CD, infraestructura como código u observabilidad.

El Aseguramiento de IA tiene un mecanismo. Se basa en tres disciplinas de ingeniería que, combinadas, hacen que el cumplimiento regulatorio sea ejecutable. No aspiracional. No un proceso manual. Ejecutable — en tu pipeline, en cada commit, con trazabilidad de auditoría.

Disciplina 1: GovOps — Gobernanza como operaciones de pipeline

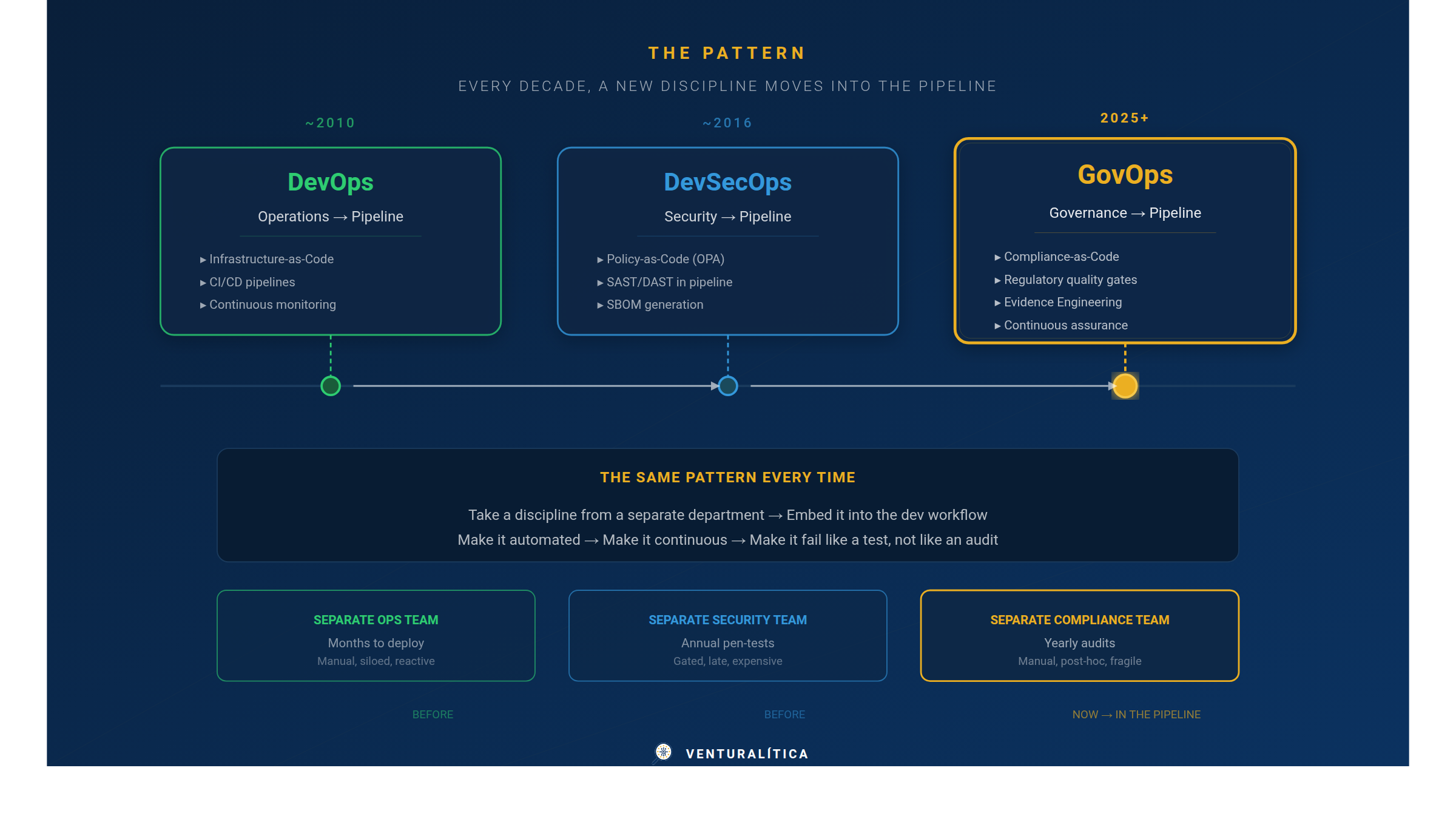

DevOps sacó las operaciones de un equipo separado y las integró en el flujo de desarrollo. DevSecOps hizo lo mismo con la seguridad. GovOps lo hace con la gobernanza.

El patrón es siempre el mismo: tomar una disciplina que vivía en un departamento aparte, con sus propios procesos, su propio calendario y su propio lenguaje — e incorporarla al ciclo de vida del software. Automatizarla. Hacerla continua. Que falle como un test, no como una auditoría.

En la práctica, GovOps significa que las verificaciones de gobernanza se ejecutan en tu pipeline CI/CD junto a tu linter y tu suite de tests. Un modelo que no supera un umbral de equidad no se despliega — igual que un servicio que no pasa un escaneo de seguridad no se despliega. El ciclo de feedback es de minutos, no de meses.

Piensa en ello como una nueva quality gate. Ya tienes gates para tests, cobertura, estilo de código y vulnerabilidades de seguridad. GovOps añade una más: cumplimiento regulatorio. Bloquea el merge, no el calendario de releases.

Piensa en ello como auditoría continua. En lugar de revisar un sistema una vez al año esperando que nada haya cambiado, recibes una señal de cumplimiento en cada ejecución del pipeline. Cuando algo se desvía de las tolerancias, lo sabes inmediatamente — no cuando un auditor lo descubre.

JFrog acuñó «DevGovOps» en 2025 para la gobernanza de la cadena de suministro. Harness ya implementa policy gates basadas en OPA en pipelines de despliegue. CML lleva CI/CD al ciclo de vida ML con GitHub Actions y GitLab CI. La infraestructura existe. Lo que falta es la capa de políticas regulatorias — las reglas que mapean obligaciones legales específicas como los Artículos 9 a 15 del EU AI Act.

Disciplina 2: Compliance-as-Code — Políticas con las que puedes hacer diff

Si GovOps es dónde se ejecuta la gobernanza (en el pipeline), Compliance-as-Code es qué se ejecuta (las reglas).

Compliance-as-Code significa expresar requisitos regulatorios como ficheros de políticas legibles por máquina, versionados, que viven en tu repositorio junto al código fuente. No un documento Word en SharePoint. No un checklist en una hoja de cálculo. Un fichero estructurado que tu pipeline puede parsear, evaluar y hacer cumplir.

El concepto no es nuevo. Open Policy Agent (OPA) lleva haciendo esto para políticas de infraestructura desde 2016. Terraform Sentinel aplica gobernanza cloud como código. AWS Config Rules evalúan cumplimiento en tiempo real. El patrón está probado a escala.

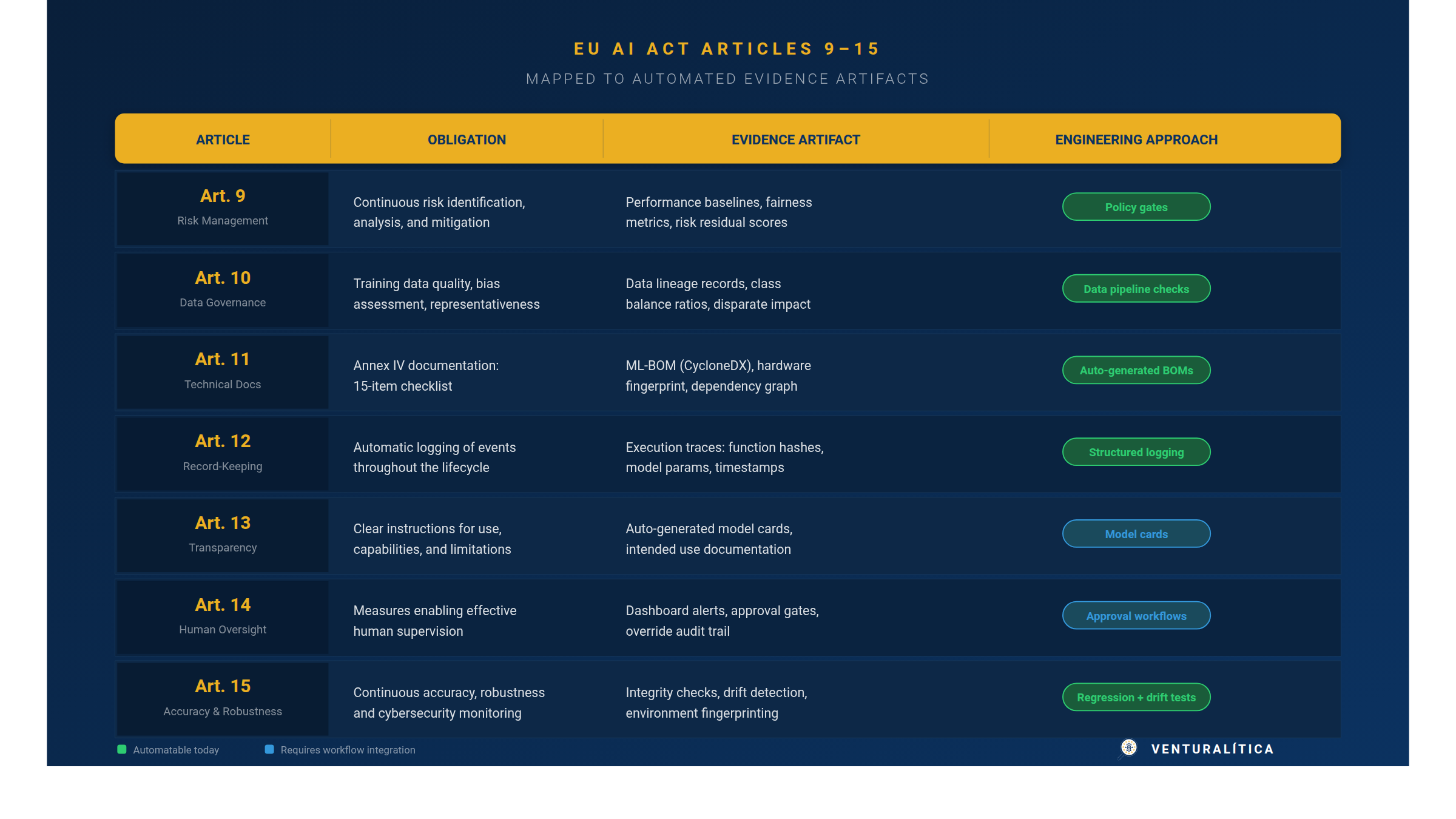

Lo nuevo es aplicarlo a regulaciones específicas de IA. El EU AI Act exige gestión de riesgos (Art. 9), gobernanza de datos (Art. 10), documentación técnica (Art. 11), registro (Art. 12), transparencia (Art. 13), supervisión humana (Art. 14) y monitorización de la precisión (Art. 15). Cada uno puede codificarse como una política con umbrales medibles.

Un ejemplo concreto: el Artículo 10 exige que los datos de entrenamiento sean «pertinentes, suficientemente representativos y, en la mayor medida posible, exentos de errores». Traducido a código, se convierte en un fichero de política que define:

- Ratio mínimo de equilibrio de clases para el atributo protegido: 0,20

- Umbral de impacto dispar (Regla de los Cuatro Quintos): 0,80

- Tolerancia de valores ausentes por feature: 0,05

Estos umbrales viven en un fichero OSCAL o YAML, revisados en pull requests, versionados con tu modelo. Cuando la regulación evoluciona — o cuando tu evaluación de riesgos cambia — actualizas la política, no un PDF.

Es eslint para cumplimiento. Las reglas son declarativas. Puedes sobreescribirlas por proyecto. Se ejecutan automáticamente. Cuando fallan, obtienes un mensaje accionable, no una opinión legal.

Cada decisión sobre umbrales es trazable. Puedes ver quién fijó el umbral de impacto dispar en 0,8, cuándo y por qué (el mensaje del commit). Cuando un regulador pregunta «¿cómo determinaron que esto era aceptable?», tienes un historial de versiones — no unas notas de reunión.

Disciplina 3: Evidence Engineering — Prueba como subproducto del pipeline

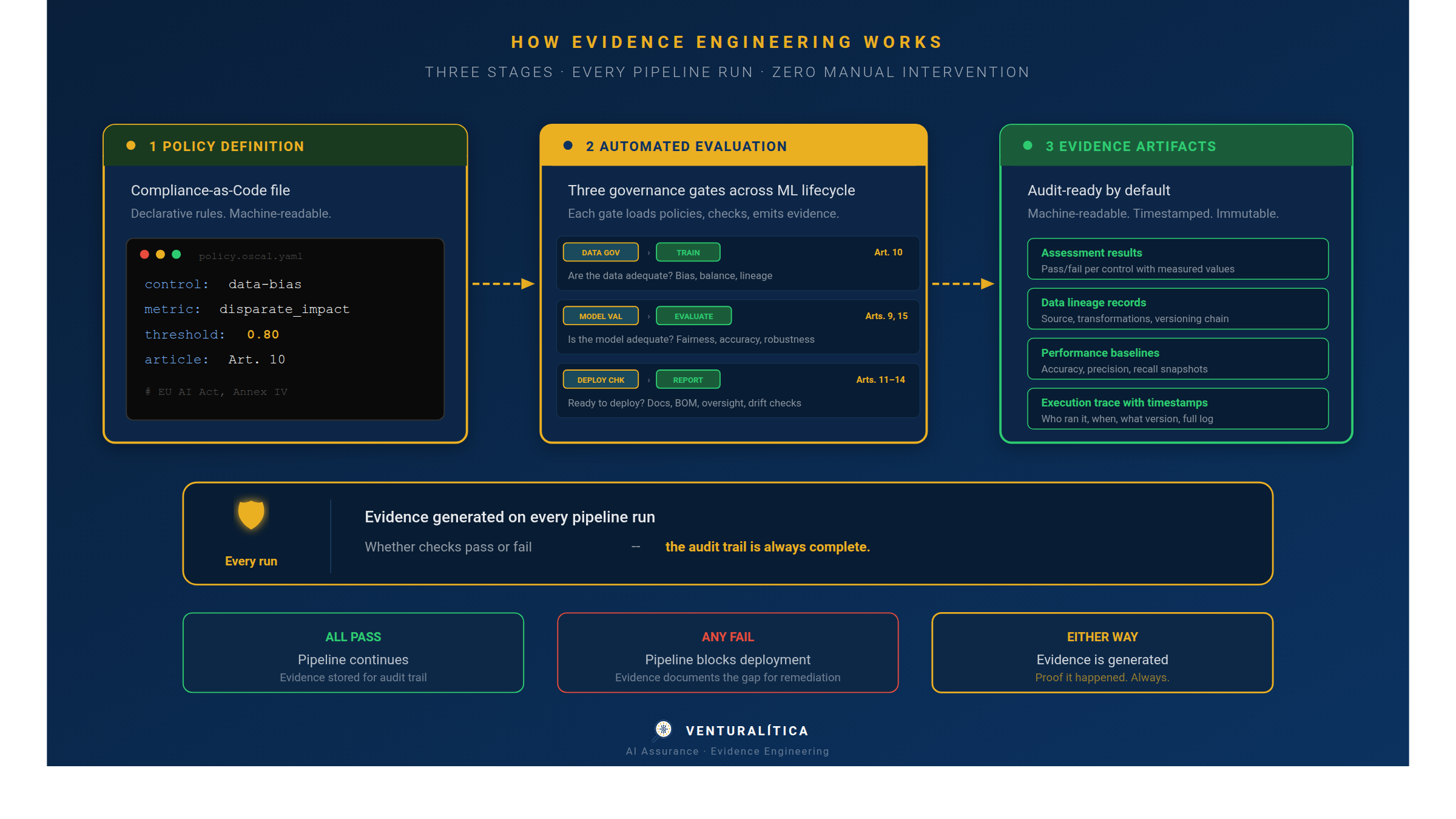

GovOps te dice dónde se ejecuta la gobernanza. Compliance-as-Code te dice qué reglas evaluar. Evidence Engineering responde la pregunta más difícil: ¿cómo demuestras que ocurrió?

El EU AI Act no solo exige que gestiones riesgos, gobiernes datos y monitorices la precisión. Exige que lo demuestres — con documentación, logs y registros que sobrevivan a una auditoría. Solo el Artículo 11 (Documentación Técnica) hace referencia al Anexo IV, un checklist que cubre desde la procedencia de los datos de entrenamiento hasta las especificaciones de hardware.

La mayoría de organizaciones tratan esto como un proyecto de documentación: alguien lo redacta después de los hechos, a menudo meses después, a menudo de memoria. Evidence Engineering invierte ese modelo. Genera artefactos de cumplimiento automáticamente, como subproducto de la ejecución del pipeline.

El principio refleja la observabilidad en sistemas distribuidos. No escribes un resumen de logs después de un incidente — tu sistema emite telemetría estructurada continuamente, y la consultas cuando la necesitas. Evidence Engineering aplica la misma lógica a la evidencia regulatoria:

- Registros de linaje de datos capturan de dónde vinieron los datos de entrenamiento, cómo se transformaron y qué métricas de calidad se midieron — abordando el Art. 10.

- Software Bills of Materials (CycloneDX ML-BOM) documentan cada dependencia, versión de framework y huella de hardware — abordando el Art. 11 y el Anexo IV.

- Trazas de ejecución registran contexto de código (firmas de funciones, hashes del código fuente), parámetros del modelo y timestamps — abordando el Art. 12.

- Verificaciones de integridad detectan drift del entorno, cambios en dependencias y desajustes de configuración entre entrenamiento y despliegue — abordando el Art. 15.

- Baselines de rendimiento capturan métricas de precisión, equidad y robustez contra conjuntos de test retenidos — abordando los Arts. 9 y 15.

Nada de esto requiere intervención manual. La evidencia se genera como parte del run de entrenamiento o evaluación, se empaqueta en artefactos estructurados y se almacena con un enlace trazable a la política que gobernó la ejecución.

Es la traza de auditoría que desearías haber tenido la última vez que alguien preguntó «¿qué versión del modelo estaba ejecutándose el 12 de marzo?» Solo que también cubre dimensiones de cumplimiento.

Es el portfolio de evidencia que lleva meses compilar manualmente — generado en segundos, actualizado en cada ejecución del pipeline, siempre al día.

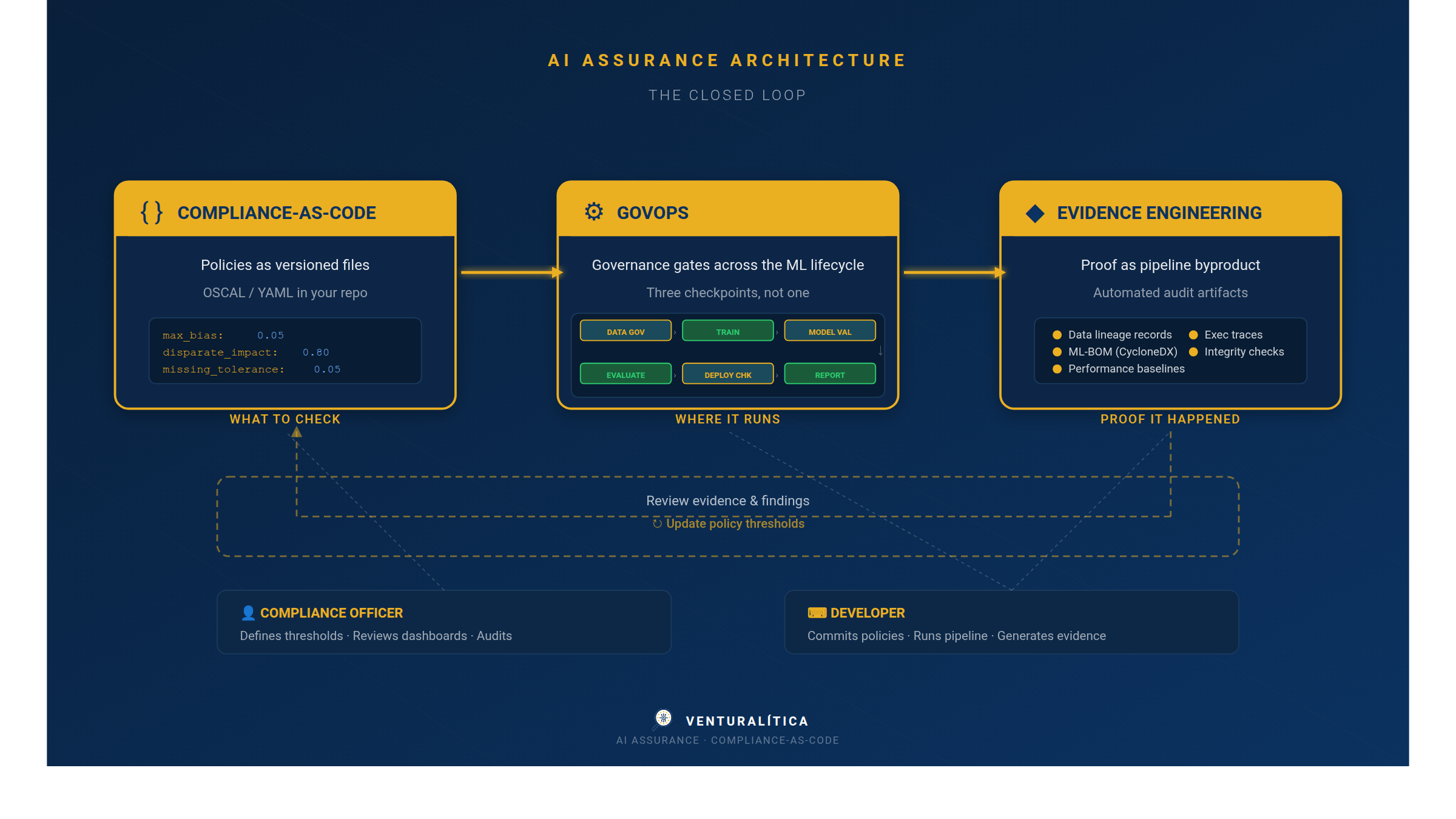

Las tres disciplinas juntas

Cada disciplina resuelve una pieza. Juntas, forman un bucle cerrado:

Un responsable de cumplimiento define la política: «el impacto dispar por edad debe estar por encima de 0,5». Un desarrollador commitea el fichero de política al repo. El pipeline CI lo evalúa en cada run de entrenamiento. Si falla, el pipeline se bloquea. Pase o falle, la evidencia queda capturada — el valor medido, el umbral, el timestamp, el snapshot de datos, la versión del código.

Seis meses después, un auditor pregunta: «¿Cómo cumplen con el Artículo 10?» No abres un documento Word. Señalas al historial de commits, los logs del pipeline y los artefactos de evidencia. Cada decisión es trazable, cada evaluación es reproducible, cada cambio de umbral es auditable.

Así es el Aseguramiento de IA cuando se ingeniería, no se consulta.

Vélo en la práctica

Si quieres experimentar el bucle — evaluación de políticas, verificación de umbrales, generación de evidencia — en un solo comando:

pip install venturalitica

import venturalitica as vl

results = vl.quickstart('loan')

# Evalúa 3 controles de equidad sobre 1.000 solicitudes reales de préstamo

# Resultado: 2 pasan, 1 falla (sesgo por edad detectado: DI = 0,286 vs umbral 0,5)

Seis segundos. Política evaluada. Evidencia generada. Una línea de código entre «asumo que mis datos son justos» y «sé que no lo son».

El SDK es open source (Apache 2.0). Las reglas de gobernanza están estructuradas en OSCAL, así que son portables a cualquier pipeline — desde workflows de CML/DVC hasta GitHub Actions, cualquier framework, cualquier jurisdicción.

GitHub: github.com/venturalitica

El Aseguramiento de IA es una arquitectura, no un servicio

La evaluación te dice dónde estás. La auditoría te dice dónde fallaste. El Aseguramiento genera la evidencia que hace útiles ambas.

No es una nueva burocracia. Son tres disciplinas de ingeniería — GovOps, Compliance-as-Code y Evidence Engineering — aplicadas a un dominio que se ha tratado como un problema legal durante demasiado tiempo.

La infraestructura ya existe: pipelines CI/CD, motores de políticas, logging estructurado, registros de artefactos. La presión regulatoria es real: las obligaciones técnicas del EU AI Act en los Artículos 9–15 aplican independientemente de si los estándares armonizados están listos. La única pieza que falta es conectarlas.

Esa conexión es el Aseguramiento de IA. Y es trabajo de ingeniería.